Основное

Содержание

Теория вероятностей

Вспомогательный раздел. Пока здесь выложены основы теории на полуинтуитивном уровне.

Случайное событие, случайная величина

На практике часто приходится сталкиваться со случайными процессами (испытаниями, опытами, наблюдениями), т.е. процессами, результаты которых различны и зависят от обстоятельств, которые мы не знаем или не умеем учитывать. Так, к примеру, при бросании игральной кости (шестигранного кубика, с гранями, занумерованными цифрами $ 1,2,3,4,5,6 $) мы не можем знать заранее какая грань окажется сверху, так как это зависит от многих неизвестных нам обстоятельств. Нельзя также предсказать заранее, сколько выпускников школы подаст в определенный год заявления на конкретный факультет СПбГУ или сколько дождливых дней будет в августе следующего года.

Применение математики к изучению подобного рода явлений опирается на то, что во многих случаях при многократном повторении одного и того же опыта в одних и тех же условиях частота появления интересующего нас результата (т.е. отношение числа опытов, в которых этот результат наблюдался, к общему числу производимых опытов) остается все время примерно одинаковой, близкой к некоторому постоянному числу.

События, которые могут произойти или не произойти на каждом шаге случайного процесса (или в результате производимого опыта) будем называть случайными событиями (или исходами данного опыта). Вероятностью события называется отношение числа равновероятных исходов, благоприятных для данного события к общему числу равновероятных исходов.

Везде в настоящем разделе предполагается, что число событий конечно.

Случайные события будем обозначать большими латинскими буквами $ A,B,S $ и т.п., а их вероятности обозначать буквой1) $ P_{} $, именно: $ P(A), P(B), P(S), \dots $.

Иногда я буду использовать и строчную букву $ p_{} $, но тогда возникает коллизия с теорией целых чисел — буква $ p_{} $ зарезервирована в ней за простым числом.

Из этого определения следует, что вероятность всегда выражается правильной дробью. Так, например, пусть имеется хорошо перемешанная колода из $ 36 $ игральных карт, и из этой колоды вынимают одну карту, тогда число случаев благоприятных тому событию, что карта будет бубновой масти ♦ равно $ 9_{} $, общее число всех равновероятных случаев равно $ 36 $. Поэтому $$ P_{} (\mbox{ появление карты бубновой масти }) = \frac{9}{36}= \frac{1}{4} . $$

Пусть случайный процесс может находиться в одном из $ n_{} $ возможных состояний $ S_1,S_2,\dots, S_n $ с вероятностями, заданными таблицей $$ \begin{array}{l|l|l|l} S_1 & S_2 & \dots & S_n \\ \hline P_1 & P_2 & \dots & P_n \end{array} \quad \mbox{ при этом } \quad P_1+P_2+\dots+P_n=1 \ . $$

Предположим, что каждое из состояний описывается появлением некоторого вещественного числа, т.е. $ S_1=a_1,\dots,S_n=a_n $ при $ \{a_j\}_{j=1}^{n} $ — различных. Например, замеры температуры в Петербурге, с интервалом в $ 12 $ часов, с точностью до десятых долей градуса попадают в набор чисел $ \{-35.9,-35.8,\dots,+37.0,+37.1\} $. В данном случае случайный процесс «оцифрован» — каждое его состояние описывается числом; для такого случайного процесса принято название случайная величина.

Математическое ожидание и дисперсия

Само название «случайная величина» обязывает как-то оценивать ее значение. Это удается сделать с помощью понятия среднего значения. Для случайной величины $ A_{} $ с таблицей вероятностей $$ \begin{array}{l|l|l|l} a_1 & a_2 & \dots & a_n \\ \hline P_1 & P_2 & \dots & P_n \end{array} \ ; P_1+P_2+\dots+P_n=1 \ . $$ средним значением или математическим ожиданием случайной величины $ A_{} $ называется число2) $$ M(A)=P_1a_1+P_2a_2+\dots+ P_n a_n \ . $$ В случае равновероятных состояний имеем: $$ M(A)= (a_1+a_2+\dots+ a_n)/n \ . $$

Таблицы вероятностей, указывающие частоту попаданий в мишень двух стрелков $ A_{} $ и $ B_{} $ имеют вид

$$

\begin{array}{c|c|c|c|c|c|c|c|c|c|c|c}

& 0 & 1 & 2 & 3 & 4 & 5 & 6 & 7 & 8 & 9 & 10 \\

\hline

A & 0.02 & 0.03 & 0.05 & 0.10 & 0.15 & 0.20 & 0.20 & 0.10 & 0.07 & 0.05 & 0.03 \\

\hline

B & 0.01 & 0.01 & 0.04 & 0.10 & 0.25 & 0.30 & 0.18 & 0.05 & 0.03 & 0.02 & 0.01

\end{array}

$$

Кого из стрелков следует считать более метким?

Кого из стрелков следует считать более метким?

Какова, на Ваш взгляд, среднегодовая температура в Петербурге? Выскажите гипотезу ![]() , а потом попробуйте найти статистику в интернете.

, а потом попробуйте найти статистику в интернете.

Еще одной характеристикой случайной величины $ A_{} $ является ее дисперсия, т.е. мера разброса значений этой величины от ее среднего значения $ M(A) $. Она вычисляется по формуле3) $$ D(A)=\sum_{j=1}^n P_j ( a_j-M(A))^2 $$ и представляет собой математическое ожидание случайной величины, равной квадрату отклонения случайной величины $ A $ от ее среднего значения $ M(A) $. Часто обозначается $ \sigma^2 $, где величина4) $ \sigma=\sqrt{D(A)} $ называется среднеквадратичным отклонением.

Так, в случае равновероятных состояний имеем: $$ D(A)=\frac{1}{n}\sum_{j=1}^n \left( a_j- \frac{1}{n} \sum_{i=1}^n a_i \right)^2=\frac{1}{n^2} \sum_{i,j=1}^n \frac{1}{2} (a_i-a_j)^2= \frac{1}{n^2} \sum_{1\le i<j \le n} (a_j-a_i)^2 \, . $$ То есть, если $ A $ обозначает какую-то из координат попаданий пули в мишень, то действительно $ D(A) $ отвечает за разброс этих попаданий.

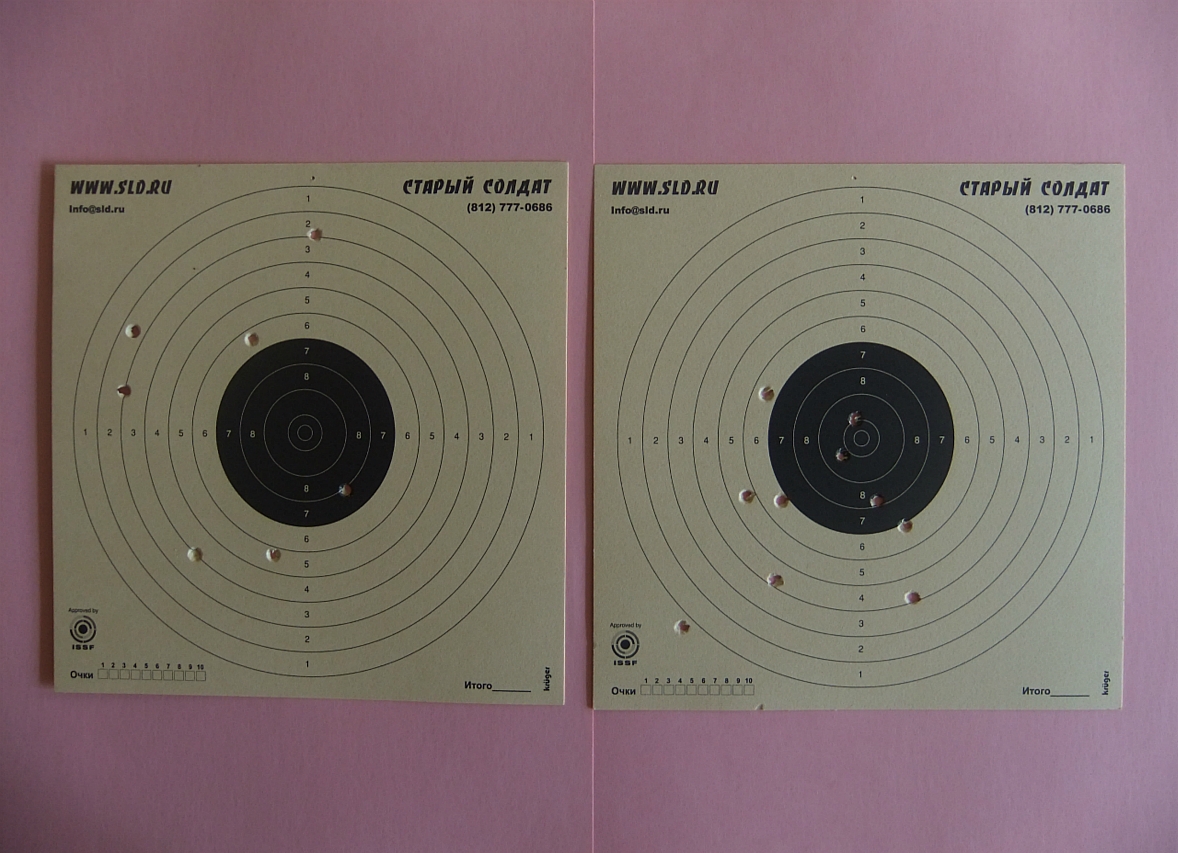

Продолжая обсуждение результатов стрельбы, зададимся следующим вопросом. Можно ли по виду двух мишений после стрельбы определить являлись ли они результатами стрельбы одного и того же человека?

Свойства вероятности

Вычисление вероятностей основано на довольно наглядных результатах. Определенная в предыдущем пункте вероятность случайного события $ A_{} $ есть правильная дробь: $$ 0 \le P(A) \le 1 \ . $$ Вероятность может равняться $ 1_{} $; это означает, что случайное событие осуществляется при любом исходе рассматриваемого опыта, т.е. событие $ A_{} $ достоверно. Вероятность может также равняться $ 0_{} $: это означает, что событие не осуществляется ни при каком исходе опыта, т.е. оно невозможно. Так, достоверным является событие извлечение белого шара из урны, в которой находятся только белые шары; невозможным является событие извлечение черного шара из той же урны.

Пусть теперь случайное событие имеет лишь два взаимно исключающих друг друга состояния: $ A_{} $ и $ B_{} $. В этом случае событие $ B_{} $ будем называть противоположным событию $ A_{} $ и обозначать $ \overline A_{} $. Если событие $ A_{} $ реализуется когда случайный процесс находится в $ m_{} $ равновероятных состояниях из $ n_{} $ возможных, то событие $ \overline A_{} $ реализуется при $ n-m $ состояниях, поэтому $$ P(A)=\frac{m}{n},\ P(\overline A)=\frac{n-m}{n}=1-\frac{m}{n}=1-P(A) \ . $$

Рассмотрим теперь два такие события $ A_{} $ и $ A_{1} $, что осуществление события $ A_{} $ влечет за собой и выполнение события $ A_{1} $. Например, $ A_{} $ — выемка карты трефовой ♣ масти из колоды карт, а $ A_{1} $ — выемка карты черной масти. В этом случае событие $ A_{1} $ заведомо выполняется при всех тех состояниях случайного процесса, при которых выполняется событие $ A_{} $; поэтому вероятность события $ A_{1} $ не может быть меньше вероятности события $ A_{} $. То обстоятельство, что выполнение события $ A_{} $ влечет за собой $ A_{1} $ будем записывать в виде $ A \subset A_1 $. Имеет место свойство: $$ P(A) \le P(A_1) \quad \mbox{ при } \quad A \subset A_1 \ . $$

Сложение событий

Рассмотрим теперь событие, которое состоит в том, что выполняется хотя бы одно из двух событий $ A_{} $ и $ B_{} $; это событие будем называть суммой событий $ A_{} $ и $ B_{} $ и обозначать $ A+B $. При этом могут иметь место два существенно различных случая. События $ A_{} $ и $ B_{} $ называются несовместимыми, если сразу оба они не могут иметь места. Найденная на улице монета не может быть одновременно и рублем и пятирублевкой.

Теорема 1 [сложения вероятностей]. Если события $ A_{} $ и $ B_{} $ несовместимы то

$$ P(A+B) = P(A)+P(B) \ . $$

Доказательство проиллюстрируем на простом примере. Предположим, например, что в ящике содержатся $ n_{1} $ белых шаров, на которых написан номер $ 1_{} $ , и $ n_{2} $ белых шаров, на которых написан номер $ 2_{} $, а также $ m_{1} $ черных шаров, на которых написан номер $ 1_{} $, и $ m_{2} $ черных шаров, на которых написан номер $ 2_{} $. Случайный процесс выемки шаров (с последующим возвращением их в ящик) может находиться в четырех состояниях: $$ S_1 = \mbox{белый шар с номером 1},\ S_2 = \mbox{белый шар с номером 2}, $$ $$ S_3 = \mbox{черный шар с номером 1},\ S_4 = \mbox{черный шар с номером 2} \ . $$ Вероятность того, что случайным образом выбранный шар окажется белым равна $ (n_1+n_2)/(n_1+m_1+n_2+m_2) $. Тот же самый результат получится если мы сложим вероятность появления белого шара с номером $ 1_{} $ с вероятностью появления белого шара с номером $ 2_{} $. ♦

Если некоторое событие представимо в виде суммы нескольких несовместимых событий, то его вероятность равна сумме вероятностей всех этих событий:

$$ P(A_1+A_2+\dots+A_k)=P(A_1)+P(A_2)+\dots+P(A_k) \ . $$

Предположим теперь, что события $ A_{} $ и $ B_{} $ не несовместимы, т.е. некоторые состояния, принимаемые случайным процессом, могут относится и к событию $ A_{} $ и к событию $ B_{} $. В этом случае уже нельзя утверждать, что $ P(A+B)=P(A)+P(B) $.

Пример. Если рассматривать пример с киданием игральной кости, и в качестве события $ A_{} $ рассматривать появление чётной кости, а событием $ B_{} $ считать появление кости, делящейся на $ 3_{} $, то

$$ P(A)=3/6,P(B)=2/6 \ \mbox{и} \ P(A)+P(B)=5/6 \, .$$ Но сумма событий $ A+B $ — т.е. событие, которое происходит либо при выпадении чётной кости, либо кости, делящейся на $ 3_{} $ — эквивалентно событию, заключающемуся в выпадении любой из костей $ \{ 2,3,4,6 \} $. Следовательно, $ P(A+B)= 4/6 \ne P(A)+P(B) $. ♦

И в общем случае можно лишь утверждать, что $$ P(A+B) \le P(A)+P(B) \ . $$

Умножение событий

Теперь попробуем уточнить последнее неравенство. Назовем произведением или совместным появлением событий $ A_{} $ и $ B_{} $ событие, которое заключается в наступлении и события $ A_{} $ и события $ B_{} $.

Пример. В примере с киданием игральной кости в качестве события $ A_{} $ рассмотрим появление чётной кости, а в качестве события $ B_{} $ — появление кости, делящейся на $ 3_{} $. Тогда произведением событий $ A_{} $ и $ B_{} $ будет событие, заключающееся в появлении кости $ 6_{} $. ♦

Пример. На дороге ГАИшник останавливает случайным образом машины. Событие $ A_{} $ заключается в том, что марка машины — японская, событие $ B_{} $ — что эта машина собрана в России. Произведением событий является то событие, что машина является японской марки, но отечественной сборки. ♦

Теорема 2. Вероятности суммы событий и их произведения связаны равенством: $$ P(A+B) = P(A)+P(B) - P(AB) \ . $$

Доказательство. В самом деле, пусть среди равновероятных состояний $ S_{j_{_1}},\dots, S_{j_{_{m_1}}} $ случайного процесса, при которых выполняется событие $ A_{} $ и $ S_{k_{_1}},\dots, S_{k_{_{m_2}}} $ состояний, при которых выполняется событие $ B_{} $, имеется ровно $ \ell_{} $ одинаковых состояний: $ S_{t_{_1}},\dots,S_{t_{_{\ell}}} $. Очевидно, если имеет место одно из состояний $ S_{t_{_1}},\dots,S_{t_{_{\ell}}} $, то имеют место оба события $ A_{} $ и $ B_{} $, поэтому $ P(AB)=\ell/n $. С другой стороны, если среди состояний $ S_{j_{_1}},\dots, S_{j_{_{m_1}}} $ и состояний $ S_{k_{_1}},\dots, S_{k_{_{m_2}}} $ имеется ровно $ \ell_{} $ одинаковых, то суммарное количество состояний равно $ m_1+m_2- \ell $. Таким образом, $$ P(A+B)=\frac{m_1+m_2-\ell}{n}=\frac{m_1}{n}+ \frac{m_2}{n}- \frac{\ell}{n}= P(A)+P(B) - P(AB) \ . $$ ♦

Применение этого правила к последнему примеру приводит к правильному выводу поскольку одновременное выпадение кости, которая будет и чётной и делящейся на $ 3_{} $ совпадает со случайным событием, заключающимся в выпадении шестёрки — и вероятность этого события $ 1/6 $.

Задача определения вероятности события $ A+B $ по вероятностям событий $ A_{} $ и $ B_{} $ сводится к нахождению вероятности произведения $ AB_{} $. Этот вопрос не тривиален и будет рассмотрен в следующем пункте.

Результат теоремы 2 обобщается и на случай произвольного числа событий.

Теорема 3. Имеет место равенство

$$ P(A_1+A_2+A_3)=P(A_1)+P(A_2)+P(A_3)-P(A_1A_2)-P(A_1A_3)-P(A_2A_3)+P(A_1A_2A_3) \ . $$

Условные вероятности

Вероятность события $ B_{} $ в том случае, когда известно, что имело место событие $ A_{} $, называется условной вероятностью события $ B_{} $ при условии $ A_{} $; она обозначается $ P_A(B) $ или $ P(B \mid A) $. В контексте этого определения вероятности $ P(A) $ и $ P(B) $ иногда называют безусловными вероятностями соответствующих событий.

Пример. В ящике лежат $ 3_{} $ черных шара и $ 1_{} $ белый. Вероятность выбора черного шара равна $ 3/4 $. Теперь предположим, что один шар убирают. Если этот шар был черным, то вероятность вытащить черный шар при следующей попытке уменьшается до $ 2/3 $; если убранный шар был белым, то вероятность вытащить следующим черный шар увеличивается до $ 1_{} $. ♦

Пример показывает, что условная вероятность может быть как больше, так и меньше безусловной. Важным случаем является и случай равенства этих вероятностей.

События $ A_{} $ и $ B_{} $ называются независимыми если наступление или ненаступление одного из них не меняет вероятности наступления другого. Пусть вероятность события $ A_{} $ ненулевая. Тогда для независимости событий $ A_{} $ и $ B_{} $ необходимо, чтобы $ P_A(B) = P(B) $. На самом деле, как покажем ниже, это условие будет и достаточным для независимости, т.е. $$ P(A) \ne 0,\ P_A(B) = P(B) \quad \Rightarrow \quad P_B(A) = P(A) \ . $$

Пример. Пусть случайный событие $ A_{} $ заключается в появлении масти карты — бубновой ♦ , червовой ♥ , трефовой ♣ или пиковой ♠ — при выборе ее из колоды в $ 36_{} $ карт. Пусть случайное событие $ B_{} $ заключается в появлении достоинства карты — шестерки,семерки, восьмерки, девятки, десятки, валета, дамы, короля или туза — при выборе ее из той же колоды. Какова вероятность появления семерки при выборе карты из колоды? — Очевидно, она равна $ 4/36=1/9 $. Предположим теперь, что из колоды выбрана карта пиковой масти. Какова вероятность, что она окажется семеркой? — Да всё та же: $ 1/9 $. К аналогичному результату придем и сменой последовательности рассуждений: если выбранная карта оказалась семеркой, то какова вероятность, что она — пика? — Да такая же, как если бы нам не была известна информация о том, что она — именно семерка. Следовательно, два события $ A_{} $ и $ B_{} $ независимы. ♦

В чем различие между независимыми событиями и несовместимыми событиями?

Теорема [умножения вероятностей]. Вероятность произведения двух событий вычисляется по правилу $$ P(AB)=P(A)P_A(B)=P(B)P_B(A) \ . $$

Доказательство. Пусть случайный процесс может находиться в одном из $ n_{} $ возможных, несовместимых и равновероятных состояний $$S_1,\dots,S_m,S_{m+1},\dots,S_{m_1},S_{m_1+1},\dots S_n \ .$$ При этом нахождение системы в первых $ m_1 $ состояний $$ S_1,\dots,S_m,S_{m+1},\dots,S_{m_1} $$ благоприятствует некоторому событию $ A_{} $, а остальные — не благоприятствуют. Пусть далее, из указанных состояний первые $ m_{} $, т.е. $ S_1,\dots,S_m $ благоприятствуют другому событию $ B_{} $, а остальные — не благоприятствуют. При таких условиях $ P(A)= m_1/n $. Вероятность же события $ B_{} $, когда известно, что событие $ A_{} $ уже произошло, равна $ m/m_1 $, так как при осуществлении события $ A_{} $ состояния $ S_{m_1+1},\dots,S_{n} $ невозможны, а состояния $ S_1,\dots,S_{_{m_1}} $ остаются по-прежнему равновероятными. Наконец, $ P(AB)= m/n $, так как совместное появление обоих событий — только в состояниях $ S_1,\dots,S_m $. Очевидно: $$ \frac{m}{n}=\frac{m_1}{n} \cdot \frac{m}{m_1} \ ,$$ что и доказывает первое равенство теоремы. Второе равенство следует из того, что $ P(AB)=P(BA) $. ♦

Вероятность произведения двух независимых событий равна произведению их безусловных вероятностей: $$ P(AB)=P(A)P(B) \ . $$

Пример. Какова вероятность появления карты семерка пик? С одной стороны, понятно, что она — как результат выбора одной карты из колоды — равна $ 1/36 $. То же число появляется в результате перемножения двух вероятностей: вероятности появления пиковой масти на вероятность появления семерки (произвольной масти). ♦

Пусть $ A_1,A_2,\dots,A_k $ — какие-то $ k_{} $ взаимно независимых события, т.е. условия опыта, с результатом которого связано какое-либо одно из этих событий, никак не зависят от выполнения или невыполнения остальных событий. В этом случае $$P(A_1A_2\times \dots \times A_k)=P(A_1)P(A_2)\times \dots \times P(A_k) \ . $$

Пример[1]. В семье — двое детей. Какова вероятность того, что оба ребенка мальчики, если известно, что в семье уже есть мальчик?

Решение. Интуитивно кажется, что ответом будет $ 1/2 $. Однако это не так. Обозначим буквами М и Д соответственно мальчика и девочку, и на первом месте будем указывать старшего ребенка5) . Имеем четыре возможности: М М , М Д , Д М и Д Д . Этим события несовместимы и имеют вероятность $ 1/4 $. Событие $ A_{} $: один из детей — мальчик; событие $ B_{} $: оба ребенка — мальчики. Если произошло событие $ A_{} $, то случайный процесс находится в одном из трех равновероятных и несовместных состояний: М М , М Д , Д М . Правильный ответ: $ P_A(B)=1/3 $. ♦

Пример. Вероятность прихода в течение четверти часа автобуса 404 к остановке у станции метро "Автово" равна $ 1/6 $, автобуса 424 — $ 1/2 $, а автобуса 224 — $ 1/3 $. Какова вероятность того, что студент, ожидающий любого из указанных видов транспорта уедет в университет в течение четверти часа?

Решение. 1. Можно решить пример применением теоремы 3 из предыдущего пункта и теоремы об умножении вероятностей. Поскольку все три события являются взаимно независимыми, то $$p(A_1+A_2+A_3)=\frac{1}{6}+\frac{1}{2}+\frac{1}{3}-\left(\frac{1}{6}\cdot\frac{1}{2}+ \frac{1}{6}\cdot\frac{1}{3}+\frac{1}{2}\cdot\frac{1}{3} \right) + \frac{1}{6}\cdot\frac{1}{2}\cdot\frac{1}{3} =\frac{13}{18} \ . $$ 2. Альтернативный способ заключается в поиске вероятности того события, что студент не уедет ни на одном автобусе. События противоположные событиям $ A_1,A_2 $ и $ A_3 $ имеют вероятности: $$ P(\overline{A_1})=1-\frac{1}{6},\ P(\overline{A_2})=1-\frac{1}{2},\ P(\overline{A_3})=1-\frac{1}{3} \ . $$ Для того чтобы студент не уехал, необходимо, чтобы не пришел ни один автобус, т.е. речь идет о событии $ \overline{A_1} \cdot \overline{A_2} \cdot \overline{A_3} $. Имеем, следовательно: $$ P(\overline{A_1})= 1- P(\overline{A_1} \cdot \overline{A_2} \cdot \overline{A_3})=1-\frac{5}{6}\cdot \frac{1}{2} \cdot \frac{2}{3} = \frac{13}{18} \ . $$ ♦

Пример. Студент выходит из здания университета и едет на "Балтийскую" на одном из видов транспорта: автобусе или электричке. В среднем, в трех случаях из четырех он идет на платформу, а в одном случае — на автобусную остановку6). Ждет транспорта $ 20 $ минут. Вероятность прихода автобуса — $ 1/2 $, электрички — $ 1/3 $. Какова вероятность, что студент уедет в город в течение этих $ 20 $ минут?

Решение. Итак, событие отъезд в город достигается при нахождении в одном из двух несовместимых состояний: $$ S_1 = \mbox{ отъезд в город на автобусе }, \quad S_2= \mbox{ отъезд в город на электричке} \ . $$ Вероятность каждого из этих двух событий вычисляется по теореме умножения вероятностей: $ P(S_1)= 1/4 \cdot 1/2 $ , $ P(S_2)= 3/4 \cdot 1/3 $. В соответствии с теоремой о сложении вероятностей, вероятность отъезда: $ P(S_1)+P(S_2)=3/8 $. ♦

В ящике имеются $ 3_{} $ карточки, на которых написана буква А , $ 2_{} $ карточки, на которых написана буква П и $ 1_{} $ карточка, на которой ничего не написано. Поочередно выбираются четыре карточки и выкладываются в ряд. Какова вероятность того, что получилось слово П А П А ?

Пусть $ M \in \mathbb N $. Определить вероятность того, что число случайным образом выбранное из множества $ \{1,2,\dots,M\} $, будет взаимно просто с $ M_{} $.

Теорема Бернулли

Теорема [Бернулли]. Если вероятность некоторого события равна $ P $, то вероятность того, что в серии из $ n $ испытаний это событие произойдет в $ m $ испытаниях равна

$$ C_n^mP^m(1-P)^{n-m} \, . $$ Здесь $ C_n^m $ — биномиальный коэффициент.

Парадокс дней рождения

В комнате находятся $ n_{} $ человек. Какова вероятность того события, что дни их рождения все различны? Будем считать, что в году — $ 365 $ дней. Интуитивно кажется, что при $ n\le 182 $ более вероятно, что все дни рождения будут различными. Однако это не так. Для наглядности рассуждений, предположим, что что люди входят в комнату один за другим — как приглашенные гости. Вероятность того, что у второго гостя день рождения не совпадает с первым равна $ 364/365 $, у третьего гостя не совпадает с первым и вторым — $ 363/365 $, и т.д., у $ n_{} $-го не совпадает со всеми пришедшими ранее — $ (365 - (n - 1))/ 365 $. Вероятность совместного осуществления всех этих событий выражается (см. ☞ теорему умножения вероятностей ) произведением $$ P_n = \frac{364}{365} \cdot \frac{363}{365} \times \dots \times \frac{366-n}{365} \ , $$ и понятно, что эта вероятность уменьшается с возрастанием $ n_{} $. Насколько быстро? $$ \begin{array}{c|c|c|c|c|c|c|c} n & 5 & 10 & 15 & 20 & 21 & 22 & 23 \\ \hline P_n & 0.9728644263 & 0.8830518223 & 0.7470986802 & 0.5885616164 & 0.5563116648 & 0.5243046923 & 0.4927027657 \\ \end{array} $$ Итак, уже среди $ 23 $-х гостей более вероятно то, что хотя бы у одной пары дни рождения будут одинаковыми, чем то, что у всех дни рождения будут различными!

Задачи

☞ ЗДЕСЬ

Источники

[1]. Феллер В. Введение в теорию вероятностей и ее приложения. Т.1. Т.2. М.Мир. 1967

[2]. Яглом А.М., Яглом И.М. Вероятность и информация. М. Наука. 1973.